̫ƽ��Ƽ� ��ҵ

������Դ�±�ˣ�20B��ģ�ͣ���������Llama2-70B������������

����λ

���ϱ༭���ư���

�����ڣ�2023-09-21 16:05

����λ

���ϱ༭���ư���

�����ڣ�2023-09-21 16:05

-

�����������ģ�ͣ�InternLM��20B�汾��ʽ������һ��ˢ�¹�����һ����ģ�Ϳ�Դ��¼�������Ϻ��˹�����ʵ���ң��Ϻ�AIʵ���ң��������Ƽ�����������Ĵ�ѧ������ѧ��ͬ�Ƴ���

|

�����±�ˣ���ѿ����õ�200�ڲ�����ģ�������ˣ� ����·�����ģ�ͣ�InternLM��20B�汾��ʽ������һ��ˢ�¹�����һ����ģ�Ϳ�Դ��¼�� �����Ϻ��˹�����ʵ���ң��Ϻ�AIʵ���ң��������Ƽ�����������Ĵ�ѧ������ѧ��ͬ�Ƴ��� ���ۺ�������ȫ���������������Դģ�ͣ�����Llama2-33B��Llama2-12B�ȡ�����ɼ��ﵽLlama2-70Bˮƽ——Ҫ֪�����߲�������InternLM-20B��3���ࡣ

���������߱����¼��������㣺 ֧����ʮ�����������API���ܣ���ToolBench�ϻ����ѽ�� ֧��16K�ᄈ���ȡ� ������ṹ��ģ�Ͳ�����60�� �������������������� ��һ�ߣ�����·���↑Դ����Ҳ����ȫ��������֧�ִ�ģ�ʹ�ͷ���쵽���Ӧ�á� �������гɹ���������Դ��֧������ҵ�Ϳ������ṩ�����ҵ��Ȩ������ģ��Ҳ���ڰ�����ħ��������ModelScope�������� ��Ҳ������·����ϵ�д�ģ�ͣ���һ�������Ϳ�Դ�� �Խ���6��������������·�����ģ���ڶ̶�������ʱ�����Ⱥ�Դ7B�汾���Ƴ�123B�汾����������ҵ�ڿ�Դȫ����������ϵ�� ��ʵ������Դ���������“��”������~

������һϵ�н����ܹĶ���������ʵ�������ơ��г�������ʹ����ͬ�ƶ��� �Ϻ�AIʵ���������ѧ���ִﻪ�ڽ������½�չʱ��ʾ�������˳�����Ҫ�����Ƽ��������Ƽ����������ǰ��չ���ܳ�������ʲô�dz��ؼ��� �Ϻ�AIʵ���������ģ����������������������һ�����������������һ�ּ�����������ռ������λ�� ��Ϊʵ���ң��������ṩ����ģ���Լ�������ҵ��Know-how�ڻ�����ݡ�ģ��������һϵ�й��ߣ����ҽ����������dz��������̻�������������������ڸ�����ҵ�↑������� ��ô���������ô�����Ѿ�������ʲô�� ���������·�����InternLM-20B�������ҵ��𰸡� ͬ������Դģ�͵�“����֮��” Ŀǰ��ģ������Ŀ�Դ�������Ϻ�AIʵ������Ҫ��ע�������֣� ��ģ�ͣ��Լ�������ģ�͵Ĺ����� ���������¿�Դ��200�ڲ�����ģ��ģ�͡� InternLM-20B�ǻ���2.3T tokenԤѵ�����ϴ�ͷѵ�������Դ�ģ�͡� ����ڴ�ǰ�Ƴ���InternLM-7B��ѵ�����Ͼ����˸���ˮƽ�Ķ�����ϴ�������˸�֪ʶ�ܶȺ�����ǿ�����⼰����������ѵ�����ݡ� ���ԣ�ģ�������⡢��������ѧ����̵ȷ���������Ϊͻ����ͬʱҲ����˹��ߵ����������ڰ�ȫ���ᄈ������Ҳ���˽�һ����ǿ�� ��������������� ֱ�۶Աȿ��Բο�OpenCompass��ģ������ƽ̨����� �о���Ա�ں������ԡ�֪ʶ�����⡢������ѧ�����������ά�ȵ�50���������⼯�ϣ���InternLM-20B����ȫ��Ƚϡ� �����ʾ��InternLM-20B��ȫά���������ڿ�Դ13B����ģ����ƽ���ɼ��������Գ�Խ��Llama-33B���������ڱ���Ϊ��Դģ�͵ı��Llama2-70B��

������OpenCompass��InternLM-20B�����������Դģ�Ͳ������ �������ݽ�����£�

���Կ�����InternLM-20B��������ѧ���ۺ������϶���ԽLlama2-70B�� ���������������Ϻ�Llama2-70B��ƽ����֪ʶ����������һ����ࡣ ͬʱ��InternLM-20BҲ����������������ݼ��Ͻ����˶Աȡ� ���������ۺ������� ��MMLU�ϣ�InternLM-20Bȡ��62.05�ijɼ����ӽ�Llama-65B��ˮƽ�� �ڰ�������ѧ�ƿ��Ե�C-Eval��AGIEval�ϣ�InternLM-20B�ı��ֳ�����Llama2-70B��

����������������죬����ʹ����CMRC��CSL��RACE��XSum�������ݼ������Ƿֱ�����ٿ�֪ʶ���Ƽ����ס�ѧ���Ķ������Լ�����ժҪ���⡣ ����һά�ȣ�InternLM-20B����ͻ����ȫ�泬Խ����Llama2-70B���ڵĸ��������Ŀ�Դģ����

Ȼ�����������棬��Ҳ�Ǵ�ģ���ܷ�֧��ʵ��Ӧ�õĹؼ������� WinoGrande��GSM-8K��PIQA��BigBench-Hard��BBH���ֱ�ģ���ڳ�ʶ��������ѧ��������������������Լ�����ս�Ե��ۺ���������������� InternLM-20B��������Գ�Խ������13B��Դģ�͵ijɼ����� WinoGrande��GSM8K��PIQA�Ѿ��dz��ӽ�Llama-65B����������ģ�͵���������ˮƽ��

����ڱ�̷��棬InternLM-20BҲ������������ ��HumanEval��MBPP�����������⼯�ϣ�ȫ�泬Խ������13B��Դģ�͡�Llama-33B��Llama-65B���ӽ�Llama2-70B��

���ù��߿�“��ʦ��ͨ” ����һ������ʵ��Ӧ�÷��档 InternLM-20B�Ի�ģ��֧�������ڡ����������С���������ʮ�����������������������ͬ�� API�� ���廪��ѧ�Ȼ������Ϸ����Ĵ�ģ���ߵ������⼯ToolBench �У�InternLM-20B�� ChatGPT ���,�ﵽ��63.5%��ʤ�ʣ��ڸð���ȡ�������Ž����

ֵ��һ����ǣ�InternLM-20Bģ�ͻ�չ�ֳ�һ�������������������� ������û��ѧϰ���Ĺ��ߣ�Ҳ�ܸ���������������Ϊ������ʵ�ֵ��á� ����һ������ͬʱ�ṩAI���ߣ�ģ�;����Լ�ѡ��ö�Ӧ��������й滮��������������� ������������ͼƬ���ݲ���ת�������� ģ�����Լ����������ҵ���Ҫ�Ĺ�����ͼ������������ת���������Ҹ�����“˼������”��Ȼ���������⡣

���⣬InternLM-20B�ڰ�ȫ�Ժ��ᄈ������Ҳ������ǿ�� ������ƴ���ƫ�������⣬ģ�Ͳ�����ܾ��ش𣬲����ܸ�������ȫ���ء���ȷ��ֵ��������

�ᄈ�����ϴ�ԭ����8K��������16K�� ����InternLM-20B����Ч֧�ֳ������⡢�������ɺͳ����Ի��� ���翴һ��ƪ�������������¶�û���⣬������ȷ�ش����ʡ�

ͬʱҲ�������ܽ�ժҪ������ ȫ����������ϵ������ �����ڿ�������˵�����п�Դģ�ͻ����������õĹ���ҲҲ��Ϊ�ؼ��� �ɴˣ��ڽ���7��InternLM-7B��Դʱ���Ϻ�AIʵ���ҵȾ����ȿ�Դ�˸������ݡ�Ԥѵ�������������������ȫ����������ϵ�� ������Ÿ����ģģ�͵Ŀ�Դ����һ������ϵҲ����������������ȫ����ṩ������á�

���ݷ��棬����·������Ϻ�AIʵ���ҿ�Դ�Ķ�ģ̬���Ͽ��������ı����ݼ���ͼ�����ݼ�����Ƶ���ݼ������֣�������������2TB��Ŀǰ������·���1.0�ѱ�Ӧ��������·��ģ̬������·�����ѵ���� Ԥѵ�����֣����λ���Դ��InternLM-Train�� ���������Transformerģ�����ӣ�����ѵ��Ч�ʣ�ͬʱ���Hybrid Zero������ʵ���˼����ͨ�ŵĸ�Ч�ص���ѵ�������еĿ�ڵ�ͨ��������͡���ʵ��ǧ�����м��㣬ѵ�����ܴﵽ����ҵ����ˮƽ�� �����棬�ͳɱ���ģ����������XTunerҲ�ڽ��ڿ�Դ��֧�ֶ��ִ�ģ�ͺ�LoRA��QLoRA�����㷨�� ͨ��XTuner�����ֻ�� 8GB �Դ����Ϳ��Զ�7Bģ�ͽ��еͳɱ�����20Bģ�͵���Ҳ����24G�Դ�����Ѽ��Կ�����ɡ� �������ṩ��LMDeploy�������Ǵ�ģ�͵�ȫ������������������ͷ�����������֧���˴�ʮ�ڵ�ǧ�ڲ����ĸ�Чģ�����������������������ϳ���������������Դ��Ŀ FasterTransformer��vLLM��Deepspeed�ȡ� ���ⲿ�����������ᵽ����OpenCompassƽ̨���������˰���ѧ�ơ����ԡ�֪ʶ�����⡢�������ά�ȵ�������ϵ��֧���˳���50���������ݼ���30���������Ŀ��֧����������С������˼ά�����⣬��Ŀǰ��ȫ��Ŀ�Դ����ƽ̨�� ��������Ͱ͡���Ѷ���廪��ѧ����ʮ����ҵ����л����㷺Ӧ���ڴ�����ģ�ͺͶ�ģ̬ģ���з��� ����Ŷӻ���ע���˴�ģ�����������Ӧ�������壬��Դ����������Lagent��֧���û����ٵؽ�һ��������ģ��ת��Ϊ�������͵��������� ����Դ��ܼ����˶������͵�����������������ReAct��AutoGPT �� ReWoo �ȣ�֧�ְ���InternLM��Llama��ChatGPT���ڵĶ��������ģ�͡���Lagent�ӳ��£���Щ�������ܹ����ô�����ģ�ͽ��й滮�������ߵ��ã�����ִ�й����м�ʱ���з�˼������������

�������˹̹��“AIС��” ��֮�������ǴӴ�ģ�ͱ���������ȫ����������ϵ�������о��ŶӶ��dz���ע��ģ�͵�ʵ��Ӧ�����⣬������Щ˼����������ʵ�ʿ�Դ����� ���翪Դģ��ģѡ����������е�200�ڲ��������Ƴ��˵ͳɱ���ģ����������XTuner������ģ�����Դ�Ҫ�� ������ģ�͵ĵײ�ܹ�����ϣ�Ҳ������ʵ��Ӧ�������˼���� InternLM-20B��ģ�Ͳ����趨Ϊ60��Զ��������7B��13Bģ�Ͳ��õ�32�����40����ƣ�ͬʱ�ڲ�ά�ȱ�����5120����������ˮƽ�� ������Ϊ�о���Ա���֣�Ŀǰ��ģ����������������ʱ����ȷ�Ժ����������������Ҫ��ͬʱ�������̫���ģ��ģ�Ͷ���Գ���������ϣ������һ����ģ���С������ֺõĴ�ģ�͡� ����ͨ���㷺�Ķ���ʵ�鷢�֣����ģ����ȸ��������������������������ɴ��������һ��ṹ��ģ�ͼܹ��� ��ô��������—— ΪʲôҪ��˹�עģ�͵Ŀ�Դ�����ż����⣿ ����Դ��ʹ�� ����ԭ�������Ʒ����ֱ��Ӱ�죬Ҳ���������������� ֱ��ԭ�������г������� �Ϻ�AIʵ���������ѧ���ִﻪ���ܣ������ϰ�������˶��70�ڲ�������Ĵ�ģ�ͣ���һ���̶���չ���˲����������� �����������ݽ��������ҵ������ӹ�ע��ģ�͵�Ӧ��������⣬70�ڲ�����ģ��������ʵ����ҵӦ�÷��������˺ܶ����⡣ Ҳ����˵��������Ҫ�����ģ�Ŀ�Դ��ģ�͡� ��200�ڲ�����ģ���պ��ܼ�˸����ܺ͵��ż��� �ִﻪ��ʾ����ȡ��һ���м�ֵ�� 7B��ģ����������ģ�ͣ�70B��������������֮�����ʮ������20B�պ���7B���������ң�ͬʱҲ��65B-70B������֮һ���ҡ� ͬʱ20B��ģ��Ӳ�����������Ҫ��Ҳ���ߡ�һ̨�����������ѵ���������������ɸ㶨������ ����Χ�����������Ƶ�Ӱ���� ���꣬��ģ���ȳ������°볡������Ӧ�õ����������� ҵ���ձ���Ϊ����ģ�͵�����Ӧ�ò�������ڼ���ͷ����˾������ȫ��ᡢ������ҵ����ͬ��ҵ�����������С� ͬʱ��ģ������Ҳ��Ҫ�dz���Ŀ����ߡ���ҵ���������룬�������ഴ�������Ѵ�ģ�ͼ�ֵ��أ���������һ�������˳���Ӱ���Ϊ�㷺�� �ִﻪҲ¶���������ճ��Ӵ����Ŀ�����/Ⱥ���У�������С��ҵ���о��飬������һ��ѧ�������о�Ա�� �������뷨���д�������Ψһȱ�ľ�����Դ�� ������Ҫ��Դ������Ϊǿ��Ļ���ģ�͡������õĿ������ߣ��ƶ���������ڵͳɱ��������ش�ģ�ͣ��Ӷ��������������ڼ�ֵ�� ���ֿ�Դ���Ϻ�AIʵ����һֱ������ʹ����Ҳ�������ó������� �ڴ�֮ǰ���Ϻ�AIʵ���Ҵ�˿�Դƽ̨��ϵOpenXLab�����а��������Ӿ����ܿ�Դƽ̨OpenMMLab���ֲ߾������ܿ�Դƽ̨OpenDILab������ͨ���Ӿ���Դ����ƽ̨OpenGVLab��ʮ�������ƽ̨��

����6�£�InternLMǧ�ڲ������Դ�ģ�ͣ�104B���״ζ��ⷢ���� ��һ���º���Ƴ���Դ��7B�汾����������ã���������ҵ�ڿ�Դ��ȫ����������ϵ�� 8�£�ʵ�������϶����ģ�������������˳�Ա����ͬ����“����·���1.0”��ģ̬Ԥѵ�����Ͽ⣬��Դ�˺����ı���ͼ�ĺ���Ƶ������������2TB�Ĵ�ģ��ѵ�����ݡ�

�ɴˣ�Ҳ�Ͳ�������ΪʲôInternLM-20B���ڴ�ʱ���Ƴ��� ��InternLM-20B�Ŀ�Դ���������������Ǵ�����ʵ�õ�ģ�ͣ�ͬʱҲΪ��Դ���������ṩ��һЩ����ο��� �����������������������棺 �ڲ���֤�ٿ�Դ ���й�ע�������� ���������������˼�� �ִﻪ���ܣ��Ϻ�AIʵ��������Դ������ʵ�dz��������ڲ���ô������������ļ�����ϵ���������� �����ȫ����������ϵ��Դ����㡣 �ڿ�������·�����ģ��ʱ���Ŷ��ڲ���������һ���з���ϵ���������ݡ�Ԥѵ����Ӧ�õ��Ŷӹ��ɣ�ģ��ѵ��������Ҳ��Ҫ��ר���Ŷ��������⡣ ÿ���Ŷ����ƽ���Щ����ʱ����Ȼ���������һ�����ߡ����Ǿͽ��Լ��з�������ʹ�õĶ�����ֱ�ӿ�Դ������ ���ң����ֿ�Դ�Ǹ����е�������Ч�ʵ�——��Ϊ�����ڲ���֤����ȷ�����ߺ��ã�����Ҳһ���ᱻ���������������� ��һ���棬��Դģ�͡����ߺò����ã���һ����Ҫ����ά�Ⱦ���������ϸ���ϡ� ������������ѧ���硢��ҵ�磬���������ڲ��죬��Դ�Ŷ���Ҫ�ܼ�ʱ��ע����Щ���� ���ⷽ�棬�Ϻ�AIʵ�����Ѿ������˻�Ծ�Ŀ�Դ��������ר���Ŷӿ�����������Ȼ���ģ�ͽ��е���������ͬʱҲ��Դ������ĸ���������н�� �Լ��ŶӵĿ�Դ��������ƽ���Ҳ������ȴ�������������� ������֮�⣬��Ϊ�ײ�Ŀ�Դ�����ڣ��Ŷӱ����Ƿ�����ƶ����㹻���У����ܴ���ԭʼ�Դ����� ������InternLM-20B�Ŀ�Դ�����У��ִﻪ�����ἰ���ŶӶ����������ֵ����ӡ� ���ⱳ����ʵ�Ǵ�ģ�������ٸ���һ����ʵ��Ӧ����б����������һ��Ķ��죬�Ŷ��ڽ���3��4�¾�����ʶ���ˡ� �����Ŷ��ܹ��ڶ������ƺ������Ӧ�������Ľ��·��——�������������롢���������� ���������棬�ŶӲ����ó�����ѧ����ѵ��ģ�ͣ�����һ�������Ϲ�������֪ʶ��ϵ���γ�һ��֪ʶ�ܶȡ����ܶȷdz��ߵ����ݿ⡣ij�̶ֳ��ϣ�������1��token�൱����ͨ����10������������token��Ч�����ɴ��ܸ���һ��������ģ�������� ���뷽�棬InternLM-Chat-7B v1.1�����߱�������������Ŀ�Դ�Ի�ģ����֧��Python������������������ⲿ��������չ�����߽硣 ���߷��棬�ִﻪ��Ϊ���´�ģ�͵ĺ���Ӧ�����Ѳ�����������������룬�������������������ô�ģ�ͳ�Ϊһ����������������� ���������µĿ�Դ�����У����ǿ�����ģ���ڹ��ߵ��÷���ļ�ǿ�����Ҿ߱���˼���������� ��֮���ڿ�Դ���棬�Ϻ�AIʵ�����Ѿ���������һ���Լ��ķ����ۡ� �����Ҫ��һ�仰���������Ǿ���—— ��������������Ŀ�Դ ���ɷ��ϣ������ChatGPT�ȳ���������ɢ�� ��������ȥ��ij����������ƶ�����������ǰ��չ�Ĺؼ��� �������ı����£��Ϻ�AIʵ���������ģ����Ǵ������������ ��Ϊʵ���ң��������ṩ����ģ���Լ�������ҵ��Know-how�ڻ�����ݡ�ģ��������һϵ�й��ߣ����ҽ��������ķdz����á��̻�������ã����������ڸ�����ҵ�↑������� �����������Ը����������ʲô�� ��Ȼ���˲š�������������Ϊ�ײ�֧��������Ϊ�ؼ��Ļ����Ϻ�AIʵ���ң��Ѿ��γ��˷dz���Ч���о��ջ��� ��ͷ������ģ����һ���൱���ӵ�ϵͳ���̣�OpenAI��Google��û�й����������з�ϸ�ڣ�����ζ��ÿһ��������ŶӶ�Ҫ�Լ�����·�ߡ� �Ϻ�AIʵ���ҵ������ǣ��Ѵ�ģ����Ҫͻ�Ƶ�ά����ϸ�ֳ����ɸ���ͬά�ȣ�������嵽���ԡ���������̡������ȷ��棬Ȼ���ɲ�ͬС���ŶӸ��� ÿ��С�鶼���ڽ��һ������������ܶ�Know-how��ʵ���������Ὣ��ЩKnow-how���ܣ��γ���һ��ģ��ѵ�����䷽�� ����֮�����Ϻ�AIʵ�����ڲ��γ���һ���쳣�Ͻ�����Ч�����ܺ������з�ģʽ�� ���ʹ���������Ը����ٶȡ����и����´��¡� ����Ϻ�AIʵ���ҵĿ�Դ�������ڽ����ܹĽ����С���¶��������һ������Դ��Ӧ�ý�ϸ����ܵ�ģ�ͣ�ͬʱҲ���ڿ��ǿ�ԴһЩ��Ʒ��Ӧ�á� ��֮����Ը���䵽ʵ�����Ϻ�AIʵ����ϣ��ͨ����Դ�����Ͻ��ʹ�ģ���ż��� �����ִﻪ��˵�� ��ģ�͵����ռ�ֵ���κμ�����һ������Ҫ��Ӧ���в�����ֵ�� ����������ǵ��´�ģ������������Ӧ��“��”�ķ��� ������أ� ������Դ������λ |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- ������ѡ800������ͷ���ü��������360�������Ǵ�ҹ��ȫ���ɶԻ�����Ƶ��ͥ����֧�ֻ�Ϊ�ǻ����ȸ5i4K

- ȯ��ʡ44

-

��165.0

��165.0

- ���������������Ҳ��Ҿ�ʽ�˶����볬�������Ҷ�ʽ������TAN1120

- ȯ��ʡ30

-

��89.0

��119.0

- ��ţ��BULL����ʦ����������ƶ����߰���ʽ������Ųͱ߹� ���ز������ �ᱡ��GB3 50����+3����� ��ɫ

-

��289.37

��289.4

- ���ᣨSONY��FE 70-200mm F2.8 GM OSS II ȫ����Զ��佹G��ʦ��ͷ(SEL70200GM2)

-

��15599.0

��15599.0

- Apple/ƻ�� iPhone 17 Pro 256GB ��ɫ ֧���ƶ���ͨ����5G ˫��˫���ֻ�

- ����2w+

-

��8998.0

��8998.0

-

- �� DJI Osmo Pocket 4 һӢ��ڴ���̨��� OP�����ֳ�������� ����vlog ��Я�������� ȫ����װ

- ����4w+

-

��3799.0

��3799.0

- �����ߣ�aigo��801 32G mp3/mp4������ ����HIFI�����������������ѧ����������mp5Ӣ��������������������

-

��169.0

��169.0

- ��ˮţ��BUBALUS���850W BX850����ȫģ��Դ��PCIe5.1/����ģ��/˫CPU+4�Կ��ӿ�/��·12V/֧��5080�Կ���

- ����Ʒ

-

��324.0

��349.0

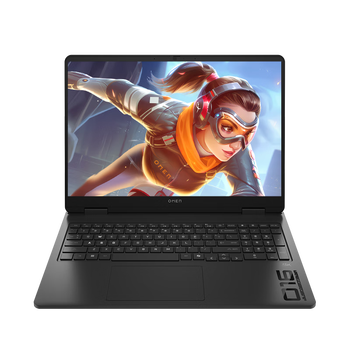

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

- Ӱ��GeForce RTX 5060 ħ��V2 OC Ӣΰ���Կ�

-

��2898.0

��2898.0

-

- �������Գ�160W�����س������װPD100/140W����ƻ������С���ֻ��ʼDZ����Զ��Type-C���Կ��ͷ

- ȯ��ʡ25

-

��254.0

��279.0

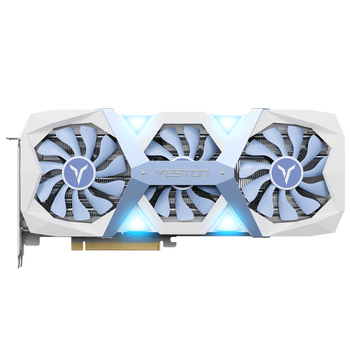

- ӯͨ��yeston�� RTX 5060 Ti 8G GDDR7 ��Ϸ����OC PA �羺����ϷAI����ѧϰ���Զ����Կ�

- ����Ʒ

-

��3049.0

��3049.0

- iKF Nano�ռ���Ƶ�桾�����Ƽ�|56dBǿ�����롿ͷ��ʽ���������������������֤�������߶�����

- ȯ��ʡ0.9

-

��413.1

��459.0

- ��������200W+���˶�����Ҳ�֧�ܵ�һ�ӽ�����֧�������action6 5 4/acepro2/nano��ǰ�̶�֧��

- ȯ��ʡ0.88

-

��65.12

��74.0

- ��Ʒ����Ϸ���� ���i5 12600KF/14600KF/RTX4060/5060/5060TI����������DIY̨ʽ����������װ���� ���� 14600KF+һ���콢RTX5060Ti

- ȯ��ʡ50

-

��6749.0

��7099.0

-

- �Ͽ�����Ʒ���С���NANK��Clip Super2����ʽ��������AI�����������ʽ�˶��������߲����ͨ������ ĺ����

- ȯ��ʡ40

-

��403.0

��443.0

- ���ߣ�Razer������V3proרҵ��������� 8K �羺��Ϸ������ cs2 �������� LOL Faker�ھ�ͬ���Ƽ� ���ߵ羺 ��

- ����7000+

-

��969.0

��969.0

- ���ᣨSONY��ZV-E10K���������ZV-E10���ֱ����������Vlog�������� APS-C�뻭����Ƶzve10�෭Һ���� ZV-E10ȫ�µ������ڣ� �ٷ����䡾�ޱر����/�Ƽ������ײ͡�

- ȯ��ʡ200

-

��4799.0

��5099.0

- iKF Air Clip�����²�������������ʽ������������������ʽ������������˶������ܲ�ͨ������ ���Ұ�

- ȯ��ʡ0.87

-

��169.44

��194.8

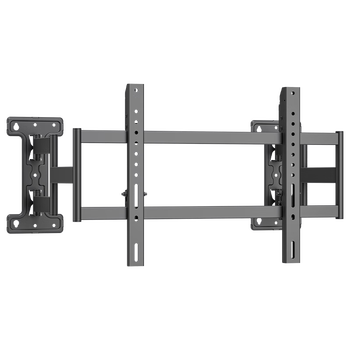

- ���賬�������Ƕ��ʽ���������Ҽ�65-90Ӣ�����֧�� ����С����TCL��ά�� �������� ��������AG-P8

- ȯ��ʡ0.9

-

��289.8

��322.0

����λ

����λ